Frecuencia de muestreo

FUNDAMENTOS DE EDICIÓN

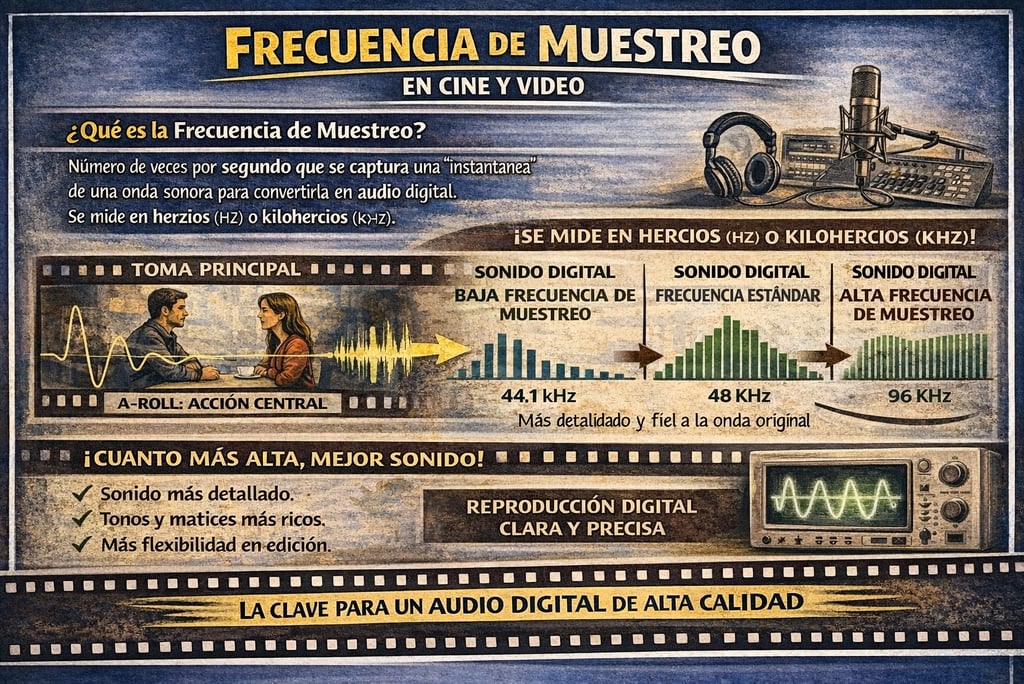

Qué es: Es el número de veces por segundo que se captura una "instantánea" de una onda sonora para convertirla en audio digital. Se mide en hercios (Hz) o kilohercios (kHz). Cuanto mayor es la frecuencia de muestreo, más fiel es la representación digital del sonido original.

Para qué sirve: Determina la calidad y la compatibilidad del audio en un proyecto. Elegir la frecuencia correcta desde el inicio (48 kHz para vídeo) evita conversiones innecesarias y problemas de sincronía entre archivos de distintas fuentes. Es una decisión que se toma una vez al configurar el proyecto y afecta a todo el flujo de trabajo.

Ejemplo: Vas a grabar una entrevista con dos cámaras y una grabadora de audio externa. Antes de pulsar REC, configuras los tres dispositivos a 48 kHz. Al importar todo en tu editor, los archivos encajan sin necesidad de convertir nada y el audio se sincroniza sin problemas.

En detalle..

Cómo funciona la digitalización del sonido

El sonido en el mundo real es una onda continua: una variación de presión en el aire que cambia de forma suave e ininterrumpida. Un sistema digital no puede almacenar esa continuidad infinita, así que la convierte en una serie de mediciones discretas. Cada medición se llama "muestra" (en inglés, sample). La frecuencia de muestreo define cuántas de esas mediciones se toman por segundo. A 48 kHz, por ejemplo, el sistema captura 48 000 instantáneas de la onda cada segundo. Cada instantánea registra la amplitud (el "volumen" en ese instante concreto) de la señal. Después, al reproducir el audio, el conversor digital-analógico (DAC) reconstruye una onda continua a partir de esos puntos, y lo que sale por los altavoces es una aproximación muy fiel del sonido original.

La frecuencia de muestreo es uno de los dos parámetros fundamentales que definen la calidad del audio digital sin comprimir. El otro es la profundidad de bits (bit depth), que se explica más adelante en esta misma ficha.

El teorema de Nyquist-Shannon y el límite de frecuencia

Detrás de todo esto hay un principio matemático clave: el teorema de Nyquist-Shannon. Este teorema establece que, para reproducir fielmente una frecuencia determinada, la frecuencia de muestreo debe ser al menos el doble de esa frecuencia. La frecuencia máxima que un sistema digital puede representar es exactamente la mitad de su frecuencia de muestreo; a ese límite se le llama frecuencia de Nyquist.

El oído humano percibe sonidos entre aproximadamente 20 Hz y 20 kHz. Por tanto, el mínimo teórico para capturar todo el rango audible sería 40 kHz. En la práctica se usa algo más —44.1 o 48 kHz— porque los filtros anti-aliasing necesitan un margen de transición para funcionar correctamente. Este margen extra entre los 20 kHz del límite auditivo y la frecuencia de Nyquist (22.05 kHz a 44.1 kHz o 24 kHz a 48 kHz) es lo que permite que los filtros hagan su trabajo sin degradar las frecuencias audibles.

Qué es el aliasing y por qué importa

El aliasing es un tipo de distorsión que aparece cuando se intenta digitalizar frecuencias que superan la mitad de la frecuencia de muestreo. Cuando esto ocurre, esas frecuencias no desaparecen: se "reflejan" hacia abajo y se manifiestan como sonidos que no existían en la señal original, a menudo como armónicos extraños y disonantes que no guardan relación musical con el sonido fuente.

Una analogía visual muy utilizada para entender el aliasing es el efecto de las ruedas en las películas del Oeste: cuando una rueda de carro gira lo bastante rápido, la cámara de cine no captura suficientes fotogramas por segundo para representar su velocidad real, y la rueda parece frenarse o girar en sentido contrario. En audio ocurre algo equivalente: si la señal contiene frecuencias demasiado altas para la frecuencia de muestreo elegida, el sistema las interpreta incorrectamente y genera sonidos falsos.

Para evitar esto, los conversores analógico-digitales (ADC) incorporan un filtro anti-aliasing, que es esencialmente un filtro de paso bajo que elimina las frecuencias por encima de la frecuencia de Nyquist antes de que la señal sea muestreada. El diseño de este filtro implica un compromiso: un filtro muy abrupto (que corte de forma agresiva justo en el límite) puede introducir artefactos como resonancias o distorsiones de fase, mientras que un filtro suave puede dejar pasar algo de aliasing. Por eso, disponer de más margen entre el límite audible (20 kHz) y la frecuencia de Nyquist facilita el trabajo del filtro, y esta es una de las razones prácticas por las que frecuencias de muestreo más altas ofrecen una ligera ventaja en la calidad del procesamiento, aunque el resultado final se consuma a 48 o 44.1 kHz.

Frecuencias de muestreo habituales y sus usos

44.1 kHz. Es el estándar del CD de audio, establecido a principios de los años 80. Su origen es técnico e histórico: los primeros sistemas de grabación digital usaban cintas de vídeo como soporte, y 44 100 muestras por segundo era la tasa más alta compatible con los formatos de vídeo PAL y NTSC de la época. Sony lo impuso como estándar del Compact Disc en 1980, y desde entonces ha quedado asociado sobre todo a la música. Sigue siendo habitual para producción musical orientada a distribución en CD o en plataformas de streaming como Spotify.

48 kHz. Es el estándar de la industria audiovisual: cine, televisión, vídeo digital y multimedia. Se adoptó con la llegada del formato DAT (Digital Audio Tape) en 1987 y desde entonces es la referencia en entornos profesionales de vídeo. Ofrece una frecuencia de Nyquist de 24 kHz (frente a los 22.05 kHz de 44.1 kHz), lo que proporciona un margen algo más amplio para los filtros anti-aliasing y para ciertas manipulaciones de postproducción. Si tu proyecto tiene un componente visual —desde un cortometraje hasta un vídeo para redes sociales—, 48 kHz es la elección correcta.

96 kHz y superiores (192 kHz). Se utilizan en grabación musical de alta resolución, en diseño de sonido profesional y en ciertos procesos de postproducción donde se necesita margen extra para manipulaciones intensivas. Una ventaja práctica de 96 kHz es que permite bajar el tono (pitch shift) de un sonido una octava completa y que conserve contenido en frecuencias altas, algo útil en diseño de efectos sonoros para cine o videojuegos. También reduce la latencia de procesamiento en plugins, ya que la latencia se mide en muestras, y a mayor frecuencia de muestreo, cada muestra dura menos tiempo. Sin embargo, para la gran mayoría de proyectos de vídeo, estas frecuencias no aportan una mejora perceptible al espectador y multiplican el tamaño de los archivos y la carga de procesamiento.

Tasas bajas (22.05 kHz, 11.025 kHz, 8 kHz). Se usan en aplicaciones donde la calidad no es prioritaria: telefonía (8 kHz), audio de baja resolución para web antigua, o efectos de sonido con ancho de banda limitado. Hoy en día tienen un uso muy marginal.

Impacto en el tamaño de los archivos

La frecuencia de muestreo influye directamente en el peso de los archivos de audio sin comprimir. La fórmula es sencilla: tamaño = frecuencia de muestreo × profundidad de bits × duración × número de canales ÷ 8. Eso da el resultado en bytes.

Para poner cifras concretas: un minuto de audio estéreo a 44.1 kHz y 16 bits ocupa aproximadamente 10 MB. Ese mismo minuto a 48 kHz y 24 bits sube a unos 17 MB. A 96 kHz y 24 bits, se duplica hasta unos 34 MB. En un proyecto con muchas pistas y horas de material, la diferencia es significativa tanto en espacio de almacenamiento como en exigencia de procesamiento para el ordenador. Por eso conviene elegir la frecuencia que realmente necesitas y no más.

La conversión de frecuencia (resampling): qué es y qué problemas causa

Cuando hay archivos grabados a distintas frecuencias de muestreo dentro del mismo proyecto, es necesario convertir unos para que coincidan con otros. Este proceso se llama remuestreo o resampling y consiste en recalcular los valores de las muestras para generar una nueva representación del audio a la frecuencia de destino.

La conversión entre 44.1 kHz y 48 kHz no es trivial matemáticamente: la relación entre ambas tasas es 147:160, un cociente que obliga al algoritmo a interpolar valores intermedios. Aunque los editores y DAWs modernos hacen esta conversión con calidad muy alta y de forma prácticamente transparente, el proceso puede introducir artefactos sutiles dependiendo de la calidad del algoritmo utilizado. No todos los programas lo hacen igual de bien: algunos generan leves ecos o reflejos de frecuencia que, aunque a menudo son inaudibles en la escucha casual, pueden acumularse cuando se aplican múltiples procesamientos.

El problema real en un flujo de trabajo no es tanto la pérdida de calidad —que con un buen conversor es mínima— sino la complejidad añadida: archivos que hay que convertir, posibles errores de sincronía si el software interpreta mal la tasa, y la pérdida de control cuando trabajas en equipo y cada persona graba con una configuración diferente. Por eso la regla de oro es simple: decide la frecuencia de muestreo antes de empezar y mantén la misma en toda la cadena.

Frecuencia de muestreo vs. profundidad de bits: no confundirlos

Uno de los errores más comunes entre principiantes es confundir estos dos parámetros. Son independientes y afectan a aspectos distintos de la calidad:

La frecuencia de muestreo (medida en kHz) determina cuántas veces por segundo se captura la señal y, por tanto, cuál es la frecuencia máxima que puede reproducirse. Afecta al rango de frecuencias. La profundidad de bits (medida en bits: 16, 24, 32) determina con cuánta precisión se mide la amplitud en cada muestra. Afecta al rango dinámico —es decir, la diferencia entre el sonido más suave y el más fuerte que el sistema puede representar sin distorsión—. A 16 bits, el rango dinámico teórico es de unos 96 dB; a 24 bits, sube a unos 144 dB.

En producción audiovisual, la combinación habitual es 48 kHz / 24 bits. Los 24 bits proporcionan un margen de seguridad enorme para la mezcla y la postproducción, permitiendo manipular niveles sin que el ruido de cuantización (el ruido inherente al proceso de digitalización) se haga perceptible.

Errores comunes

El error más frecuente es no comprobar la configuración antes de grabar y descubrirlo en postproducción, cuando ya hay archivos a distintas frecuencias que hay que convertir. El segundo error habitual es pensar que "más es mejor" y grabar a 96 kHz sin una razón técnica concreta, multiplicando el espacio en disco y la carga del sistema sin obtener un beneficio audible. El tercer error, menos obvio, es subir la frecuencia de muestreo de un archivo que ya fue grabado a una tasa inferior, creyendo que mejorará la calidad: en realidad, el remuestreo hacia arriba no añade información nueva que no existiera en la grabación original; solo aumenta el tamaño del archivo.

Configuración práctica recomendada

La mejor práctica es decidir la frecuencia de muestreo al principio del proyecto y configurar todos los dispositivos involucrados al mismo valor: cámara, grabadora de audio, interfaz de audio y software de edición (DAW o NLE). Si el destino del proyecto es audiovisual —cine, televisión, vídeo online, podcast con vídeo—, la recomendación clara es 48 kHz. Si trabajas exclusivamente en música para distribución en CD o streaming, 44.1 kHz sigue siendo una opción válida, aunque muchos profesionales optan ya por 48 kHz como frecuencia universal. En cuanto a la profundidad de bits, 24 bits es el estándar de producción actual, independientemente de la frecuencia elegida.

Relación con otros conceptos

La frecuencia de muestreo está vinculada a varios conceptos del flujo audiovisual. Se relaciona con la profundidad de bits y el bitrate (tasa de bits), ya que juntos determinan el peso y la calidad del audio sin comprimir. Guarda relación con los formatos de archivo: WAV y AIFF almacenan audio sin comprimir y respetan la frecuencia de muestreo original; MP3, AAC u OGG comprimen el audio reduciendo el bitrate mediante algoritmos con pérdida. También se conecta con la sincronización audiovisual, ya que una frecuencia de muestreo uniforme y correcta garantiza que el audio se alinee con el vídeo en la línea de tiempo del editor. Y, como hemos visto, se relaciona directamente con el concepto de aliasing y con el diseño de los filtros anti-aliasing que utilizan los conversores.